Megrez

Collection

Megrze

•

4 items

•

Updated

🔗 GitHub | 🏠 Infini-AI MaaS | 📖 WeChat Official | 💬 WeChat Groups

中文 | English

Megrez-3B-Instruct是由无问芯穹(Infinigence AI)完全自主训练的大语言模型。Megrez-3B旨在通过软硬协同理念,打造一款极速推理、小巧精悍、极易上手的端侧智能解决方案。Megrez-3B具有以下优点:

我们使用开源评测工具 OpenCompass 对 Megrez-3B-Instruct 进行了评测。部分评测结果如下表所示。

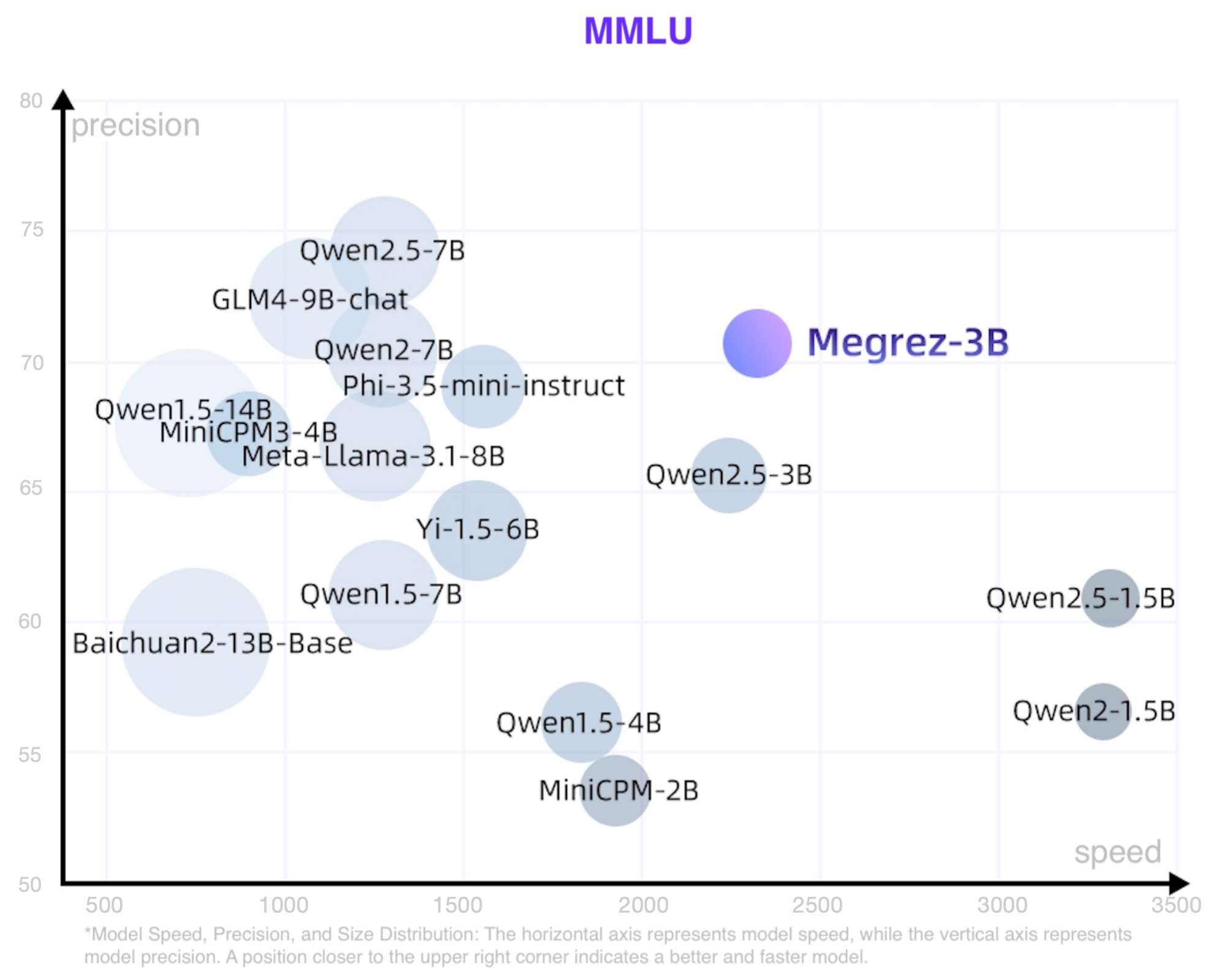

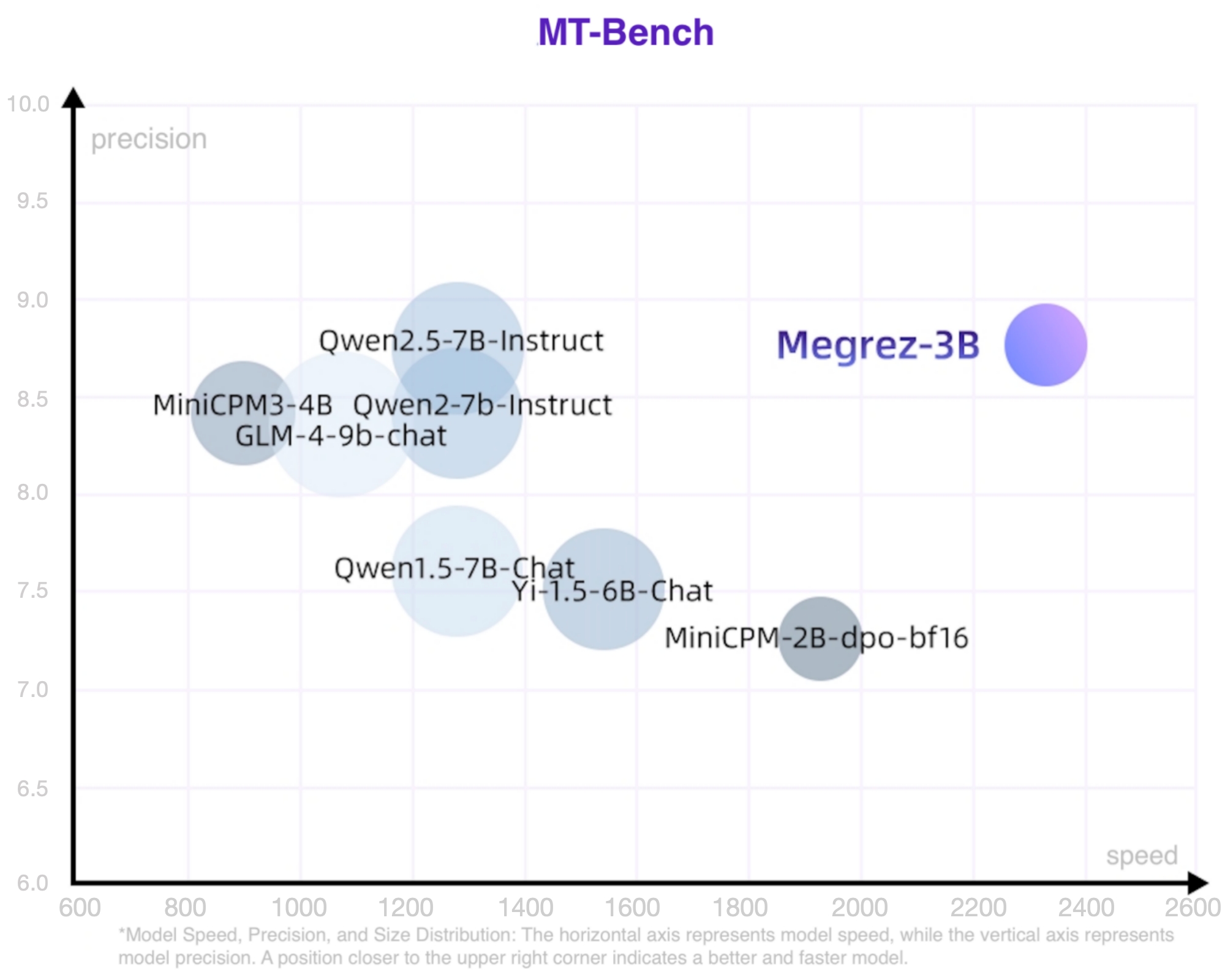

速度精度模型大小散点图如下,位置越靠近右上表明模型越好越快。

| 模型 | 指令模型 | # Non-Emb Params | 推理速度 (tokens/s) | C-EVAL | CMMLU | MMLU | MMLU-Pro | HumanEval | MBPP | GSM8K | MATH |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Megrez-3B-Instruct | Y | 2.3 | 2329.4 | 84.8 | 74.7 | 72.8 | 46.1 | 78.7 | 71.0 | 65.5 | 28.3 |

| Qwen2-1.5B | 1.3 | 3299.5 | 70.6 | 70.3 | 56.5 | 21.8 | 31.1 | 37.4 | 58.5 | 21.7 | |

| Qwen2.5-1.5B | 1.3 | 3318.8 | - | - | 60.9 | 28.5 | 37.2 | 60.2 | 68.5 | 35.0 | |

| MiniCPM-2B | 2.4 | 1930.8 | 51.1 | 51.1 | 53.5 | - | 50.0 | 47.3 | 53.8 | 10.2 | |

| Qwen2.5-3B | 2.8 | 2248.3 | - | - | 65.6 | 34.6 | 42.1 | 57.1 | 79.1 | 42.6 | |

| Qwen2.5-3B-Instruct | Y | 2.8 | 2248.3 | - | - | - | 43.7 | 74.4 | 72.7 | 86.7 | 65.9 |

| Qwen1.5-4B | 3.2 | 1837.9 | 67.6 | 66.7 | 56.1 | - | 25.6 | 29.2 | 57.0 | 10.0 | |

| Phi-3.5-mini-instruct | Y | 3.6 | 1559.1 | 46.1 | 46.9 | 69.0 | - | 62.8 | 69.6 | 86.2 | 48.5 |

| MiniCPM3-4B | Y | 3.9 | 901.1 | 73.6 | 73.3 | 67.2 | - | 74.4 | 72.5 | 81.1 | 46.6 |

| Yi-1.5-6B | 5.5 | 1542.7 | - | 70.8 | 63.5 | - | 36.5 | 56.8 | 62.2 | 28.4 | |

| Qwen1.5-7B | 6.5 | 1282.3 | 74.1 | 73.1 | 61.0 | 29.9 | 36.0 | 51.6 | 62.5 | 20.3 | |

| Qwen2-7B | 6.5 | 1279.4 | 83.2 | 83.9 | 70.3 | 40.0 | 51.2 | 65.9 | 79.9 | 44.2 | |

| Qwen2.5-7B | 6.5 | 1283.4 | - | - | 74.2 | 45.0 | 57.9 | 74.9 | 85.4 | 49.8 | |

| Meta-Llama-3.1-8B | 7.0 | 1255.9 | - | - | 66.7 | 37.1 | - | - | - | - | |

| GLM-4-9B-chat | Y | 8.2 | 1076.1 | 75.6 | 71.5 | 72.4 | - | 71.8 | - | 79.6 | 50.6 |

| Baichuan2-13B-Base | 12.6 | 756.7 | 58.1 | 62.0 | 59.2 | - | 17.1 | 30.2 | 52.8 | 10.1 | |

| Qwen1.5-14B | 12.6 | 735.6 | 78.7 | 77.6 | 67.6 | - | 37.8 | 44.0 | 70.1 | 29.2 |

本表只摘出有官方MT-Bench或AlignBench点数的模型

| 模型 | # Non-Emb Params | 推理速度 (tokens/s) | MT-Bench | AlignBench (ZH) |

|---|---|---|---|---|

| Megrez-3B-Instruct | 2.3 | 2329.4 | 8.64 | 7.06 |

| MiniCPM-2B-sft-bf16 | 2.4 | 1930.8 | - | 4.64 |

| MiniCPM-2B-dpo-bf16 | 2.4 | 1930.8 | 7.25 | - |

| Qwen2.5-3B-Instruct | 2.8 | 2248.3 | - | - |

| MiniCPM3-4B | 3.9 | 901.1 | 8.41 | 6.74 |

| Yi-1.5-6B-Chat | 5.5 | 1542.7 | 7.50 | 6.20 |

| Qwen1.5-7B-Chat | 6.5 | 1282.3 | 7.60 | 6.20 |

| Qwen2-7b-Instruct | 6.5 | 1279.4 | 8.41 | 7.21 |

| Qwen2.5-7B-Instruct | 6.5 | 1283.4 | 8.75 | - |

| glm-4-9b-chat | 8.2 | 1076.1 | 8.35 | 7.01 |

| Baichuan2-13B-Chat | 12.6 | 756.7 | - | 5.25 |

| 模型 | # Non-Emb Params | 推理速度 (tokens/s) | IFeval strict-prompt | BBH | ARC_C | HellaSwag | WinoGrande | TriviaQA |

|---|---|---|---|---|---|---|---|---|

| Megrez-3B-Instruct | 2.3 | 2329.4 | 68.6 | 72.6 | 95.6 | 83.9 | 78.8 | 81.6 |

| MiniCPM-2B | 2.4 | 1930.8 | - | 36.9 | 68.0 | 68.3 | - | 32.5 |

| Qwen2.5-3B | 2.8 | 2248.3 | - | 56.3 | 56.5 | 74.6 | 71.1 | - |

| Qwen2.5-3B-Instruct | 2.8 | 2248.3 | 58.2 | - | - | - | - | - |

| Phi-3.5-mini-instruct | 3.6 | 1559.1 | - | 69.0 | 84.6 | 69.4 | 68.5 | - |

| MiniCPM3-4B | 3.9 | 901.1 | 68.4 | 70.2 | - | - | - | - |

| Qwen2-7B-Instruct | 6.5 | 1279.4 | - | 62.6 | 60.6 | 80.7 | 77.0 | - |

| Meta-Llama-3.1-8B | 7.0 | 1255.9 | 71.5 | 28.9 | 83.4 | - | - | - |

| 单文档问答 | 多文档问答 | 概要任务 | 少样本学习 | 人工合成任务 | 代码任务 | 平均 | |

|---|---|---|---|---|---|---|---|

| Megrez-3B-Instruct | 39.7 | 55.5 | 24.5 | 62.5 | 68.5 | 66.7 | 52.9 |

| GPT-3.5-Turbo-16k | 50.5 | 33.7 | 21.25 | 48.15 | 54.1 | 54.1 | 43.63 |

| ChatGLM3-6B-32k | 51.3 | 45.7 | 23.65 | 55.05 | 56.2 | 56.2 | 48.02 |

| InternLM2-Chat-7B-SFT | 47.3 | 45.2 | 25.3 | 59.9 | 67.2 | 43.5 | 48.07 |

| Longbench-Chat | |

|---|---|

| Megrez-3B-Instruct | 4.98 |

| Vicuna-7b-v1.5-16k | 3.51 |

| Mistral-7B-Instruct-v0.2 | 5.84 |

| ChatGLM3-6B-128k | 6.52 |

| GLM-4-9B-Chat | 7.72 |

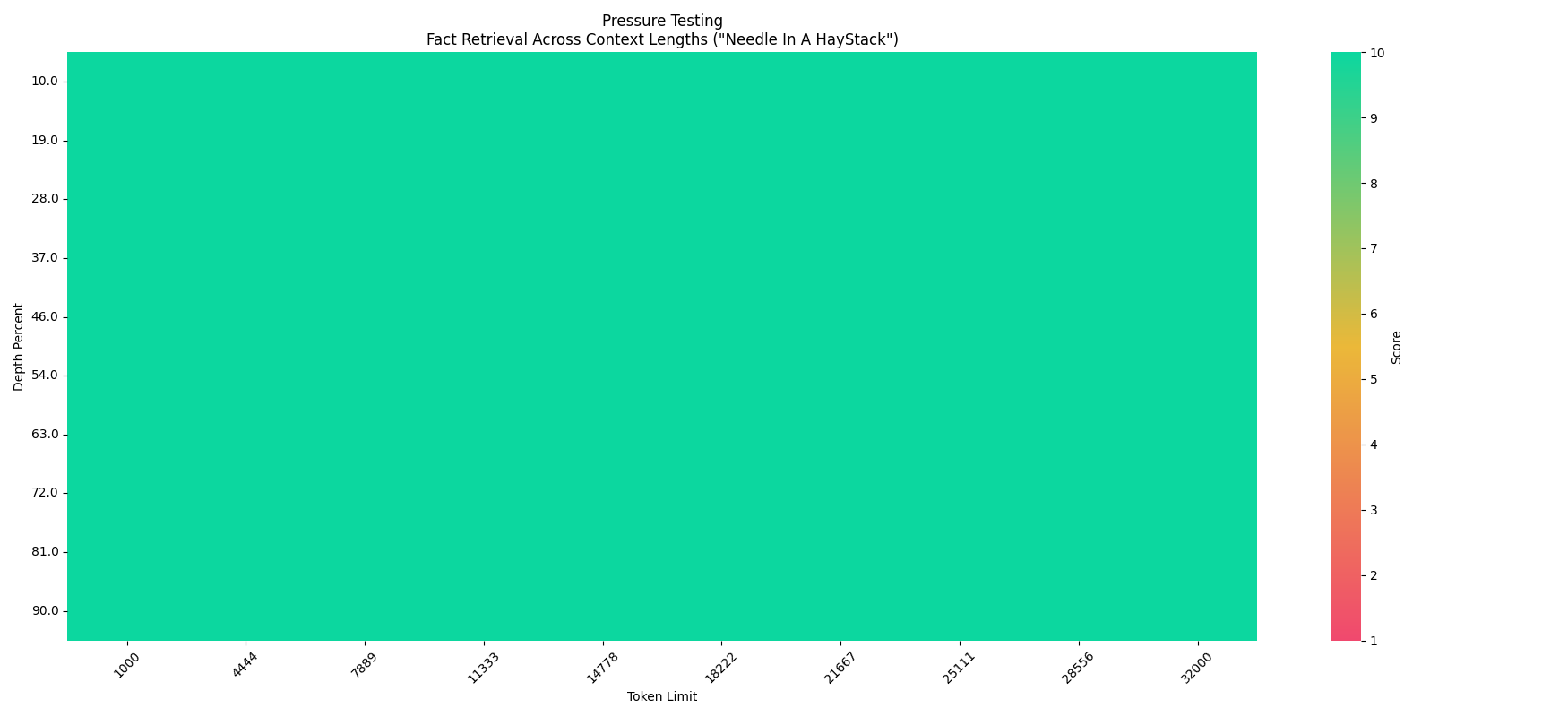

Megrez-3B-Instruct在32K文本下的大海捞针压力测试全部通过

我们模型进行了针对性训练,并提供了完整的工程部署方案。InfiniWebSearch 具有以下优势:

我们对模型进行了针对性训练,使模型可以自动决策搜索调用时机,在搜索和对话中自动切换,并提供更好的总结效果。我们提供了完整的部署工程代码 ,用户可以基于该功能构建属于自己的Kimi或Perplexity,克服小模型常见的幻觉问题和知识储备不足的局限。

安装transformers后,运行以下代码。

from transformers import AutoModelForCausalLM, AutoTokenizer

import torch

path = "Infinigence/Megrez-3B-Instruct"

device = "cuda"

tokenizer = AutoTokenizer.from_pretrained(path, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(path, torch_dtype=torch.bfloat16, device_map=device, trust_remote_code=True)

messages = [

{"role": "user", "content": "讲讲黄焖鸡的做法。"},

]

model_inputs = tokenizer.apply_chat_template(messages, return_tensors="pt", add_generation_prompt=True).to(device)

model_outputs = model.generate(

model_inputs,

do_sample=True,

max_new_tokens=1024,

top_p=0.9,

temperature=0.2

)

output_token_ids = [

model_outputs[i][len(model_inputs[i]):] for i in range(len(model_inputs))

]

responses = tokenizer.batch_decode(output_token_ids, skip_special_tokens=True)[0]

print(responses)

# Install vLLM with CUDA 12.1.

pip install vllm

from transformers import AutoTokenizer

from vllm import LLM, SamplingParams

model_name = "Infinigence/Megrez-3B-Instruct"

prompt = [{"role": "user", "content": "讲讲黄焖鸡的做法。"}]

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

input_text = tokenizer.apply_chat_template(prompt, tokenize=False, add_generation_prompt=True)

llm = LLM(

model=model_name,

trust_remote_code=True,

tensor_parallel_size=1

)

sampling_params = SamplingParams(top_p=0.9, temperature=0.2, max_tokens=1024)

outputs = llm.generate(prompts=input_text, sampling_params=sampling_params)

print(outputs[0].outputs[0].text)